Google-Workspace-Chefin: Alles mit KI, aber mit Bedacht

Kristina Behr, Produkt-VP für Google Workspace, erklärt im Interview, wie Docs und Co. schlauer werden sollen – und warum der KI-Rollout eher langsam erfolgt.

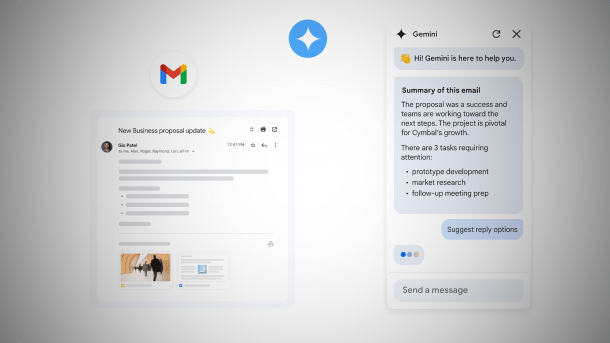

Google Gemini for Workspace.

(Bild: Google)

Kristina Behr ist seit Januar 2023 Vice President of Product für Google Workspace und dort auch für die Integration generativer KI in die Workspace-Produkte Drive, Docs, Sheets und Slides verantwortlich. Zuvor arbeitete sie als Vice President of Product und General Manager in den Bereichen Workflows und KI-Forschung bei Microsoft. 2014 bis 2017 war sie außerdem als Produktmanagerin für die ersten Bing-Apps unter iOS und Android verantwortlich, die der Softwareriese mittlerweile zu Chatbots aufgerüstet hat.

heise online: Wir hatten Bard in Gmail, wir hatten Duet AI und jetzt gibt es Gemini für Google Workspace – es gab schon viele Namen für Googles KI-gestützte Produktivitätsanwendungen. Warum fällt es Ihnen eigentlich so schwer, eine gute Bezeichnung zu finden?

Kristina Behr: Da fragen Sie die falsche Person (lacht). Das Branding und die Branding-Diskussionen sind eher etwas für unsere Marketing-Teams. Ich habe also keine gute Antwort darauf.

Die Leute experimentieren derzeit noch viel. Welche wirklich guten Anwendungsfälle sehen Sie denn für KI-Werkzeuge von Workspace in einem geschäftlichen Kontext?

Das kommt ganz darauf an. Innerhalb unseres Workspace-Labs-Programms haben wir jetzt etwa eine Million "Trusted Testers". Sie nutzen die Vorteile von Gemini for Workspace im Kontext von Gmail, in Docs, in Sheets, in Slides. Die Verwendungszwecke sind sehr unterschiedlich und hängen von den jeweiligen Geschäftsanforderungen ab.

Eine davon ist beispielsweise das Marketing. Wir haben einen Kunden, der Gemini for Workspace nutzt, um Texte für Produktbeschreibungen auf seiner Website neu zu erstellen. Die Leute, die vorher diese Texte für Produktbeschreibungen geschrieben haben, arbeiten jetzt an wirkungsvolleren Marketingkampagnen.

Ein anderer Kunde nutzt unsere KI-Funktionen für den Kundenservice, etwa, um Antworten auf die Fragen und Anliegen seiner Kunden zu verfassen. Dadurch konnte der Zeitaufwand für die Erstellung solcher Nachrichten um 30 bis 35 Prozent reduziert werden.

(Bild: Google)

Ich persönlich finde Gemini for Workspace sehr hilfreich, um die tägliche Informationsflut zu bewältigen. Die Tatsache, dass Gemini wirklich gut darin ist, E-Mails zusammenzufassen und mir dabei hilft, lange Dokumente zu raffen, so dass ich einen Überblick über die wichtigsten Punkte erhalte, ist sehr nützlich.

Auf den ersten Blick ist es etwas verwirrend, was an Gemini for Workspace schon allgemein verfügbar ist und was nicht. Vieles gibt es offenbar bislang nur im Bereich Ihrer Labs.

Wir haben eine ganze Reihe von Funktionen, die allgemein verfügbar sind. So gibt es beispielsweise "Help Me Write" in Gmail und Docs. Wir haben "Help Me Create Images" in Slides verfügbar gemacht. Wir haben auch die Möglichkeit, Tabellen für das Projektmanagement in Sheets zu erstellen. Alle diese Funktionen sind in GA, also General Availability.

Die sogenannte Seitenpanel-Erfahrung ist allerdings bislang nur für Labs-Nutzer verfügbar. Das soll die übergreifende KI-Funktion für Workspace werden. Sie können dann beispielsweise in Gmail nach mehr Kontext zu einem Dokument fragen, das in Drive gespeichert ist, und das System wird in der Lage sein, die zentralen Punkte herauszuziehen und sie in ein neues Docs-Dokument einzubringen. Dazu werden wir Mitte Mai zur Google I/O sicher mehr sagen können.

Im Vergleich zu Ihren Mitbewerbern scheint Google bei der Veröffentlichung seiner KI-Funktionen relativ vorsichtig zu sein. Warum gehen Sie das so langsam an?

Das liegt daran, dass wir dabei sehr viel Wert auf Qualität legen. Arbeiten diese Features technisch gesehen? Ja, sicher. Aber funktionieren sie auch auf dem Niveau unserer Google-Standards? Wir glauben, dass es für das Business und den Arbeitskontext sehr wichtig ist, es richtigzumachen. Andere Unternehmen treffen da vielleicht andere Entscheidungen, was die Veröffentlichung solcher Produkte angeht.

Ich bin, ehrlich gesagt, stolz auf Google, weil es die Messlatte hoch angesetzt hat, was die Frage angeht: Ist die Antwort, die ein KI-System liefert, korrekt? Ist sie genau genug? Ist sie umfassend? Hat das Modell den Prompt richtig verstanden? Es ist wichtig, dass wir ein gutes Gefühl bei den Rückmeldungen haben, die wir in den Labors erhalten, bevor wir zur allgemeinen Verfügbarkeit übergehen.

Auf der Google Cloud Next im April haben Sie Google Vids gezeigt, eine neue Software zur Generierung für Geschäftsvideos. Es wirkte nicht so beeindruckend wie das, was Konkurrenten wie OpenAI mit Sora oder Runway mit seinem Videogenerator machen.

Man muss sich Google Vids als eine KI-gestützte Videoerstellungs-App für die Arbeit vorstellen. Sie nutzt eine Reihe von verschiedenen KI-Bausteinen, aber es ist eben nicht nur ein Baustein. Es geht nicht nur um die Umwandlung von Text zu Video. Wie kann man sich zum Beispiel ein Storyboard für ein Video einfach erstellen lassen? Wie baut man ganz einfach ein Skript? Wie erstellt man auf einfache Weise das dazu passende Voiceover? Wie findet man Stock-Videos, Bilder, Hintergrundmusik und fügt diese zusammen, um ein Video zu erstellen, das für den Arbeitskontext geeignet ist? Wir haben hier ein All-in-One-Werkzeug gebaut.

Es ist eine ganz andere Anwendung als Text-zu-Video-Apps, was zwar eine wichtige Komponente bei der KI-Erstellung eines Videos ist. Aber ich glaube nicht, dass es das ist, worum es uns hier geht – nämlich wie man mit dem Medium Video in einem Business-Kontext wirklich tolle Geschichten erzählen kann.

Dog-Fooding bei Google

Wir alle wissen, dass KI in Geschäftsanwendungen nicht halluzinieren sollte. Wie implementieren Sie hier die notwendigen Leitplanken, damit das nicht passiert?

Das ist der Grund, warum wir in unseren Testphasen so vorsichtig sind. Wir verbringen viel Zeit in der sogenannten Dog-Fooding-Phase, also intern bei Google, wo wir dann alles ausprobieren. Wir nutzen die Features tagtäglich im Arbeitskontext, bevor sie an die Öffentlichkeit kommen. Und dann verbringen wir ausreichend Zeit damit in den Workspace-Labs mit Trusted Testers, um die letzten Probleme zu lösen.

Und zur Frage mit den Leitplanken: Es gibt verschiedene Techniken, die wir verwenden. Ich denke, ein Großteil davon dreht sich um die Frage, wie wir das sogenannte Corpus Grounding einsetzen. Der Nutzer bekommt dann seine Antwort, aber eben auch Quellenangaben zu bestimmten Dateien. Das System wird mich also an die richtigen Stellen verweisen.

Das hilft nicht nur dabei, Halluzinationen zu reduzieren, sondern macht es auch für den Endbenutzer einfacher, Antworten der KI zu überprüfen und selbst nachzuvollziehen. Und so machen wir es Business-Kontext eben.

Viele Leute sagen, KI sei bei der Texterstellung zwar bereits interessant, das Problem sei aber, zu überprüfen, was stimmt und was nicht. 80 Prozent des Outputs sind in Ordnung, aber wie finde ich die restlichen 20 Prozent, die falsch sind?

Ich denke, hier ist unsere Funktion einer zusätzlichen Überprüfung mittels Google-Suche so großartig. Sie erhalten dann die Links zu Quellen. Das ist auch eines der Dinge, für die ich so dankbar bin, bei Google zu arbeiten – die Tatsache, dass wir eine erstklassige Suchmaschine haben, die uns dabei helfen kann. Und natürlich auch den Nutzern.

Gemini for Workspace nutzt das Material der Nutzer nicht für Trainingszwecke. Wie stellen Sie sicher, dass keine Datenlecks entstehen? Sie erlauben es ja nicht, Ihr Modell mit Kundendaten zu tunen, oder?

Ich denke, dass unser Ansatz, die neuesten und besten Techniken zu verwenden, um Kontext an das Modell weiterzugeben, bessere Ergebnisse liefert, aber eben auf eine sicherere Weise. Wenn man Geschäftsdaten zum Tuning der Modelle annimmt, ergeben sich einige der potenziellen Probleme, die Sie bereits in Bezug auf Sicherheit und Datenschutz angedeutet hatten.

Unser Ansatz ist dabei stets, dass Ihre Daten Ihre Daten sind. Wir nutzen Informationen aus Ihrem Korpus in der Cloud, wobei wir nur Dinge, auf die Sie selbst Zugriff haben, als Kontext an das Modell weitergeben. Aber wir speichern diese Informationen nicht, nutzen sie nicht zum Training und nicht zum Finetuning. Denn das birgt das Risiko, dass Daten an andere Kunden geraten könnten.

(bsc)